Робоэтика

Робоэтика -- Роботы

Этика - это раздел философии, изучающий мораль. Мораль - это ценности и нормы, регламентирующие поведение (взаимодействие) людей, которые они усваивают в ходе социализации. По сути, это результаты договоренностей в том или ином конкретном обществе, обеспечивающие его единство. В разных обществах этические нормы могут заметно различаться.

Робоэтика - это один из подвидов так называемой этики технологий, в которую принято относить этику искуственного интеллекта, которую в свою очередь подразделяют на машинную этику и робоэтику.

В узком смысле слова робоэтика описывает отношение к роботам. Как и каких роботов проектируют, строят, как затем относятся к роботам. Машинная этика описывает принятие этических решений машинами, в нашем случае - роботами. Иногда под робоэтикой (ошибочно? или расширительно) понимают именно этику ИИ, объединяя в одно понятие собственно робоэтику и этику ИИ.

Робоэтика - это наука, описывающая социальные, моральные и юридические аспекты внедрения роботов в жизнь человеческого общества. Задача робоэтики сформулировать "законы робототехники". Можно вспомнить три закона робототехники Азимова, но на практике придется решать гораздо большее число проблем, нежели описанные в его произведениях, поэтому нужны новые подходы к этой тематике. Робоэтика не описывает нормы этического взаимодействия человека и робота. Некоторые специалисты, занимающющиеся вопросами робоэтики, называют себя киберфилософами.

Ряд общественных организаций пытаются вести разработки тематики робоэтики. Например, в 2010 году Агентство EPSRC, UK (исследовательский совет научных и инженерных разработок) представил свою версию принципов Робоэтики, адресованных разработчикам роботов. В частности, они предложили, чтобы юридическую ответственность за роботов и их ошибки несли люди.

Французские исследователи в 2014 году составили этический кодекс для взаимодействия человека и робота, также адресованных разработчикам.

Примеры этических проблем или "сложных вопросов"

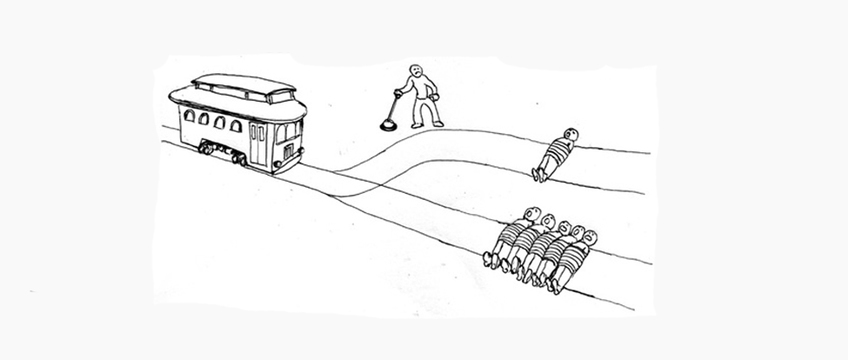

1. Известная "проблема вагонетки" 1967 года (Filippo Foot, Джудит Томпсон). Два варианта - есть железнодорожный путь, на нем спят 5 человек. По пути движется вагонетка. Вы наблюдаете эту картину, но не можете предупредить ни спящих, ни водителя вагонетки. У вас есть возможность перевести стрелку, тогда 5 человек не умрут, но на пути, куда вы отправили вагонетку, есть 1 человек. Допустимо ли спасти 5 ценой одного? Ваши действия?

Модификация вопроса - вы стоите не у стрелки, а на мосту над путями. Рядом с вами - очень большой человек. Если столкнете его на путь, вагонетка не сможет продолжать движение и 5 спящих не пострадают. Следует ли столкнуть человека, зная, что он наверняка погибнет? Готовы ли это сделать?

И, наконец, можно ли доверить роботу решение таких вопросов? Какие решения ему предпринять, окажись он в роли "стрелочника". Кого должен будет давить самоуправляемый автомобиль, если у него будет только две альтернативы, каждая из которых заведомо ведет к смерти людей? Представьте, робот-автомобиль едет по улице и попадает в ситуацию, когда должен сделать выбор - врезаться в маму с коляской или в группу мужчин, стоящих на переходе, а других вариантов решения просто не существует. Какое решение следует принять роботу? Будет ли это принцип "меньшего ущерба"? Кто возьмет на себя формулирование соответствующих алгоритмов?

2. Люди, хотя и "связаны" до какой-то степени нормами культуры и моралью (совестью и общественным порицанием), сохраняют свободу выбора отклоняться от этих норм, пусть даже за этим последует то или иное "наказание". Разрешим ли мы роботам иметь "свободу выбора"?

3. Попытки формулировать людьми "законы" не идеально работают для людей и могут оказаться неприменимыми для роботов в силу невозможности давать точные толкования ряду понятий и невозможности обобщить все возможные ситуации и комбинации факторов. Как говорится, любое обобщение - есть ложь, к законам это вполне относится. Это обусловливает, например, невозможность использования "законов Азимова", - попробуйте например дать четкое толкование "вред человеку"? Подразумевает ли это, что роботы должны врать людям, чтобы их не огорчать, или ограничивать их свободу для того, чтобы минимизировать опасности, связанные с взаимодействием человека с миром за пределами контролируемого роботом помещения? Должен ли робот иметь право причинять вред конкретному человеку в целях служения идее "блага всего человечества"?

4. Допустимы ли "взрослые отношения" роботов и людей, в частности, можно ли регистрировать брак между человеком и роботом? Является ли секс с роботом проявлением неверности супруге/супругу? Поможет ли появление роботов "для взрослых" решить проблему сексуального рабства или усугубит ее? Допустима ли разработка специальных роботов для людей с девиантным сексуальным поведением? (Можно ли, например, изготовлять роботов-детей, роботов-калек?). Это поможет снизить уровень насилия над детьми или напротив, усугубит ситуацию? Можно ли считать соотвествующие формы взаимодействия с роботами преступлениями? Если речь о секс-роботе, но сегодня он не хочет секса, может ли он отказать человеку? Если секс-робот отказал человеку, может ли человек его принудить? Может ли робот после такого инцидента вызвать насильника в суд?

Можно вспомнить, что в 2016 году компания Softbank, Япония, уже включила в пользовательское соглашение запрет на сексуальное и непристойное взаимодействие с роботом Pepper. Как это контролируется?

5. Можно ли бить, ломать своего робота, пытать его (если им кажется, что они способны испытывать боль, или даже если они на это не способны), уничтожать? Является ли отключение мыслящего робота убийством робота? Если посторонний человек пытается уничтожить вашего робота-жену, можете ли вы защищать этого робота, как члена семьи ли только как имущество? Где пределы необходимой обороны в этом случае?

6. Если робот снабжен "личностью", можно ли продолжать считать его собственностью (рабом?)? Может ли принадлежать что либо роботу? Можно ли завещать имущество роботу, который получил личность вашего покойного супруга?

7. Если робот нечаянно или по каким-то мотивам убил человека, кто за это отвечает - робот, владелец робота, компания-производитель, автор ПО?

8. Можно ли помещать "клон" личности умершего человека в робота для "продолжения общения" с ушедшим человеком?

2016.05.24 Поговорить с "цифровой копией" умершего человека? Возможно ли и этично ли? Стартап Luka выпустил чат-бота на основе переписки погибшего в автокатастрофе человека - Романа Мазуренко, бывшего арт-директора небезызвестной в Москве "Стрелки".

9. Можно ли дать роботам право голосовать, обязанность платить налоги и т.п.? Могут ли результаты деятельности робота принадлежать ему? Может ли робот выкупить себя у своего первоначального собственника? Может ли существовать робот, не имеющий хозяина?

2016.12.17 Дмитрий Гришин представил проект регулирования правового статуса роботов в России.

10. Допустимо ли использовать роботов, например, в качестве сиделок? Некоторые считают, что такой подход не может быть этичным, пожилым и больным людям нужно тепло людей, а не забота механизмов. Здесь по-моему, ответ однозначен, все по-местам расставит сама жизнь. Людей-сиделок на всех не хватает, а робот - намного лучше, чем ничего. Этот вопрос, пожалуй, не является сложным в отлчиие от остальных.

11. Не будут ли последствия общения с социальными роботами разрушительными для человеческого общества. Не потеряют ли люди, общаяясь с "идеальным партнером" навыки социальной коммуникации с другими людьми, не являющимися идеальными партнерами? Не предпочтут ли замкнуться на взаимодействии с механическими идеальными партнерами, отказавшись от общения с другими людьми.

12. Можно ли наделять роботов правом убивать людей? Допустимо ли, если робот применяет силу против человека, например, в ситуации, когда в случае его бездействия погибнет несколько других людей? А если взрослый пытается убить детей, а робот теоретически мог бы ему помешать? Допустимо ли создание автономных роботов-солдат? Роботов-полицейских? Кто будет нести ответственность за их действия? Следует ли людям договориться о том, чтобы не создавать роботов, вооруженных летальным оружием и действующим автономно?

Еще в 2009 году в мире запущена НКО "".

2016.12.23 / snob.ru

2016.12.18 Экcперт по ИИ Тоби Уолш - нужно запретить автономных боевых роботов

13. Можно ли разрешать роботам совершать суицид?

2016.12.23 / snob.ru

Прогнозы и тренды

2056

Ожидается, что к 2056 году роботы с ИИ получат права, возможно, вплоть до права участвовать в выборах и обязанности платить налоги. Это прогноз компании Outsights вместе с Ipsos Mori. Прогноз основан на идее, что если интеллект роботов достигнет уровня развития современного человека, то роботы могут захотеть аналогичный правовой статус, по крайней мере будет справедливо им его предоставить.

2016.12.07 К 2056 году роботы с ИИ получат права, схожие с правами людей / RoboTrends.ru

2016

2016.12.18 Экcперт по ИИ Тоби Уолш - нужно запретить автономных боевых роботов

2016.12.17 Дмитрий Гришин представил проект регулирования правового статуса роботов в России.

Публикации по теме

2018.03.19 Робот для битья. Назначение робота-черепахи Shelly, разработанной в Naver Labs - приучить детей к гуманному обращению с роботами. Черепаха, оснащённая набором сенсоров, реагирует на механические воздействия на неё изменением подсветки частей панциря, а также прячет под него конечности и голову, если обращаться с ней грубо. Если же её погладить, черепаха может по-другому менять подсветку или даже трясти лапами “от радости”. Всего у черепахи 8 типов эмоций.

2017.09.05 В Германии предложены этические рекомендации для разработчиков ПО самоуправляемых автомобилей и автопилотов. Основные тезисы: Жизнь человека важнее, чем жизнь животного или какое-либо имущество. Никакой дискриминации в вопросе о том, кто должен выжить. Необходимы усилия по защите от хакеров.

2017.07.05 Ученые обещают революцию в машинной этике

2016.12.23 / snob.ru

2016.12.18 Экcперт по ИИ Тоби Уолш - нужно запретить автономных боевых роботов

2016.12.17 Дмитрий Гришин представил проект регулирования правового статуса роботов в России.

2016.10.26 Международный конгресс "Любовь и секс с роботами" состоится в Лондоне в декабре. Встреча пройдет с 19 по 20 декабря 2016 года в Университете Голдсмита в Лондоне. Представители академической науки, а также разработчики встретятся и обсудят свои идеи и работы на симпозиуме. Кроме того, будут представлены роботы андроиды с высоким сходством с человеком, киберсексуальные игрушки, роботы для взрослых и т.п. Конференция продлится 2 дня.

2016.05.24 Поговорить с "цифровой копией" умершего человека? Возможно ли и этично ли? Стартап Luka выпустил чат-бота на основе переписки погибшего в автокатастрофе человека - Романа Мазуренко, бывшего арт-директора небезызвестной в Москве "Стрелки".

2016.04.13 . Обсуждение старой темы - что делать в связи с роботами с нерешенными человечеством проблемами типа Trolley Dilemma.

2016.03.18 Несколько компаний хотят помещать личности умерших людей в роботов. Помимо технологичной доработки роботов, которая, вероятно, займет не один десяток лет, потребуется также время для того, чтобы “робореинкарнация” стала социально-приемлемой. #робоинкарнация #TerasemMovement

2016.03.15 Дилеммы робототехники и беспилотные автомобили, способные убить человека. Представим себе беспилотный автомобиль с четырьмя пассажирами, который несется навстречу бетонной стене. Все люди, находящиеся внутри, неизбежно погибнут. Но что если автоматика в последний момент изменит курс и спасет пассажиров, задавив случайного пешехода, проходящего мимо? Вправе ли системы искусственного интеллекта принимать такое решение? Если до сих пор эту проблему каждый раз решал для себя конкретный человек-водитель, то роботам-водителям следует дать универсальную инструкцию. Не решенные человечеством этические проблемы наконец-то придется решать и формализовать?

2016.03.03 Люди доверяют спасательному роботу больше, чем здравому смыслу. Это выявили в США экспериментально. Соответственно от разработчиков робототехники требуется высокая ответственность, ведь их изделиям люди готовы будут доверить свою жизнь.

2015.08.07 . .

2015.05.26 . Для чего искуственному интеллекту нужна сексуальность. Об этом беседуют специалист по искуственному интеллекту, писатель, терапевт в области сексуальности и человеческих отношений.

2015.05.08 . Профессор Аркадий Ющенко, профессор кафедры «Робототехнические системы и мехатроника» МГТУ им. Н.Э. Баумана, о том, почему машина с искуственным интеллектом должна быть внешне похожей на человека.

+ +

Смотрите связанные статьи Robo-педии:

Смотрите связанные статьи Robo-педии:

Публикации по теме:

18.03.2019 Люди возненавидят компетентных роботов

18.03.2019 Люди возненавидят компетентных роботов 24.02.2019 Киберпанк, который мы заслужили?

24.02.2019 Киберпанк, который мы заслужили? 12.02.2019 Люди не готовы “убивать” антропоморфных роботов

12.02.2019 Люди не готовы “убивать” антропоморфных роботов 19.03.2018 Робот для битья

19.03.2018 Робот для битья 24.11.2017 В RoboPravo подготовили Модельную конвенцию о робототехнике и искусственном интеллекте

24.11.2017 В RoboPravo подготовили Модельную конвенцию о робототехнике и искусственном интеллекте 05.09.2017 В Германии предложены этические правила для искинов-водителей

05.09.2017 В Германии предложены этические правила для искинов-водителей 06.07.2017 Судебная система должна адаптироваться к появлению “умных” роботов

06.07.2017 Судебная система должна адаптироваться к появлению “умных” роботов 05.07.2017 Ученые обещают революцию в машинной этике

05.07.2017 Ученые обещают революцию в машинной этике- 24.05.2017 Большинство людей предпочли бы взаимодействовать с дружелюбными роботами, но не во Франции и Японии

21.01.2017 В комитете Европарламента одобрили инициативу создания добровольного Кодекса этического поведения

21.01.2017 В комитете Европарламента одобрили инициативу создания добровольного Кодекса этического поведения 18.12.2016 Экcперт по ИИ Тоби Уолш - нужно запретить автономных боевых роботов

18.12.2016 Экcперт по ИИ Тоби Уолш - нужно запретить автономных боевых роботов 17.12.2016 Дмитрий Гришин представил проект регулирования правового статуса роботов в России

17.12.2016 Дмитрий Гришин представил проект регулирования правового статуса роботов в России 07.12.2016 К 2056 году роботы с ИИ получат права, схожие с правами людей

07.12.2016 К 2056 году роботы с ИИ получат права, схожие с правами людей 28.11.2016 ТГУ запускает курс "Мой друг - робот" по социальной робототехнике на Coursera

28.11.2016 ТГУ запускает курс "Мой друг - робот" по социальной робототехнике на Coursera 26.10.2016 Международный конгресс "Любовь и секс с роботами" состоится в Лондоне в декабре

26.10.2016 Международный конгресс "Любовь и секс с роботами" состоится в Лондоне в декабре 10.07.2016 Полицейские США использовали робота-сапера, чтобы взорвать стрелявшего в них человека

10.07.2016 Полицейские США использовали робота-сапера, чтобы взорвать стрелявшего в них человека 21.06.2016 Люди больше ценят роботов, которых собрали самостоятельно

21.06.2016 Люди больше ценят роботов, которых собрали самостоятельно 24.05.2016 Поговорить с "цифровой копией" умершего человека? Возможно ли и этично ли?

24.05.2016 Поговорить с "цифровой копией" умершего человека? Возможно ли и этично ли? 18.03.2016 Несколько компаний хотят помещать личности умерших людей в роботов

18.03.2016 Несколько компаний хотят помещать личности умерших людей в роботов 15.03.2016 Дилеммы робототехники и беспилотные автомобили, способные убить человека

15.03.2016 Дилеммы робототехники и беспилотные автомобили, способные убить человека 03.03.2016 Люди доверяют спасательному роботу больше, чем здравому смыслу

03.03.2016 Люди доверяют спасательному роботу больше, чем здравому смыслу 11.02.2016 Поведение робота изменится в зависимости от личности владельца

11.02.2016 Поведение робота изменится в зависимости от личности владельца 19.01.2016 Роботы-убийцы - придет ли мир к соглашению?

19.01.2016 Роботы-убийцы - придет ли мир к соглашению? 28.11.2015 Роботов научат говорить человеку “нет”

28.11.2015 Роботов научат говорить человеку “нет” 08.11.2015 Роботы для взрослых - чего не стоит ожидать от первого поколения

08.11.2015 Роботы для взрослых - чего не стоит ожидать от первого поколения

Ethics and Artificial Intelligence: The Moral Compass of a Machine Trolley Dilemma.